Kálmán László nyelvész, a nyest szerkesztőségének alapembere, a hazai nyelvtudomány és nyelvi ismeretterjesztés legendás alakjának rovata volt ez.

- Elhunyt Kálmán László, a Nyelvész, aki megmondja

- Így műveld a nyelvedet

- Utoljára a bicigliről

- Start nyelvstratégia!

- Változás és „igénytelenség”

Kálmán László korábbi cikkeit itt találja.

Ha legutóbb kimaradt, most itt az új lehetőség!

Ha ma csak egyetlen nyelvészeti kísérletben vesz részt, mindenképp ez legyen az!

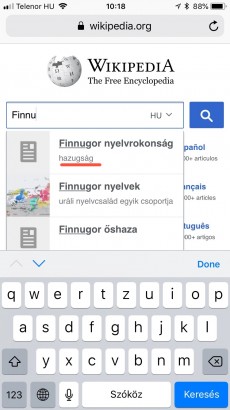

Finnugor nyelvrokonság: hazugság

A határozott névelő, ami azt jelenti, hogy ‘te’

Az oroszok már a fejünkön vannak!

Fórum cikk: Utolsó mondat vége: "....amikor elvont, akkor viszont kérdés, hogy mihez kötődik." (mármint a főnév)..A főnév valamilyen típusú nyelvtani szerkezethez és a benne meglévő elemekhez mindenképpen kötődik. Ha mereven "statikus" a szerkezet, vagyis mereven szabályosak az elemek (korlátozott számban, és értelemben), "képtelen" arra, hogy érzelmeket fejezzen ki, előre látóan (vizsgálódva, mérlegelve), optimálisan helyes döntéseket hozzon, mint ahogy arra az élő világ akár elemi szinten, vagy bonyolult megnyilvánulásaiban is képes.Az un. "folyamatos"', vagy "szenvedő" igéknek pl. már az elnevezése is mutatja, hogy "szerkezetre" (összességében annak elemeire) utalnak, nem pedig önállóan dönteni és tudatában fejlődni képes természetes, vagy amit szeretnének megvalósítani, "mesterséges" agyra.Az agy eszköze a gondolkozás, ami tapasztalatokra épül.A nyelv a kommunikáció különleges, rugalmas eszköze (valamilyen/ bármilyen élőlény valamilyen módon létrehozta) a spontán ész (a genetikai fejlődési szint szerinti "agy", vagy annak korábbi fejlődéstani elemei) mint "okosmotor termékei" és a bel (visszacsatolás az okosmotorhoz a belső működés optimalizálására), valamint a változó időben és térben történő fejlődés, túlélés biztosítására.A valóságban a folyamatok nagyon sokfélék lehetnek, mert a "mozgató rugói" sokfélék.A folyamatok rugóinak sokfélesége ha végtelennek látszik, véletlenről beszélünk, aminek, vagy amiknek az oka -amennyiben fontos az ok (jelentős tényező a sokféle kutatási ágban) kiderítése- kutatjuk, és az eredményeket felhasználva, a folyamatokat befolyásoljuk, vagy nem, ha nem találtuk meg... Ha rossz irányba viheti az addigi folyamatot a megtalált ok (előre látás mérlegelés útján, korábbi ismeretek felhasználásával) elvetjük a kezdeti "késztetést" ("észnélküliségnek", mivel nem kontrollált, de akár az is kiderülhet hogy jó volt a "spontán" gondolat) a további folyamatok fenntartásához vagyis az ész által nem ellenőrzött de számunkra tetszetős, megvalósított gondolatokat, és a visszacsatolt összes adatot feldolgozva és a környezettel összhangba hozás szándékával, megerősítjük vagy módosítjuk, vagy elvetjük azt. Még ekkor is van tévedési lehetőség, mert minden szemszögből többnyire szinte lehetetlen a vizsgálódás, ezért nevezik optimalizálásnak.Szerintem, a "folyamatos, vagy szenvedő ige" típusú merev szabályrendszer a nyelvben" alkalmazására épülő optimalizálás (ami programban tükröződik) kevés és nem "biológiai modern", gondolkozni képes robotok megvalósítására. A lényegesnek vélt valós helyzetek térben és időben követése és az adatok feldolgozása, a korábbi ismeretekkel együtt, megközelítheti egy "szuper agy" típusú gépi intelligencia létrehozását.

- A fentiek miatt, fontosnak gondolom, hogy az IKES ige (ami éppen fejlődés alatt áll) a magyarban elnyerje a különlegesen sokoldalú helyzet elemzést „jelölő”, a „késztetés- elhatározás” folyamatára visszaható igék csoportja nevet.

(A ragozása Esz. 1Sz.-ben is, ha határozatlan tárgyas a ragozás, maradjon azonos minden ilyen típusú igével!!)

Mivel ez hosszú lenne, talán az „optimalizátor” ige megfelelő lenne.. :)

Fórum cikk: Utolsó mondat vége: "....amikor elvont, akkor viszont kérdés, hogy mihez kötődik." (mármint a főnév)..

A főnév valamilyen típusú nyelvtani szerkezethez és a benne meglévő elemekhez mindenképpen kötődik. Ha mereven "statikus" a szerkezet, vagyis mereven szabályosak az elemek (korlátozott számban, és értelemben), "képtelen" arra, hogy érzelmeket fejezzen ki, előre látóan (vizsgálódva, mérlegelve), optimálisan helyes döntéseket hozzon, mint ahogy arra az élő világ akár elemi szinten, vagy bonyolult megnyilvánulásaiban is képes.

Az un. "folyamatos"', vagy "szenvedő" igéknek pl. már az elnevezése is mutatja, hogy "szerkezetre" (összességében annak elemeire) utalnak, nem pedig önállóan dönteni és tudatában fejlődni képes természetes, vagy amit szeretnének megvalósítani, "mesterséges" agyra.

Az agy eszköze a gondolkozás, ami tapasztalatokra épül.

A nyelv a kommunikáció különleges, rugalmas eszköze (valamilyen/ bármilyen élőlény valamilyen módon létrehozta) a spontán ész (a genetikai fejlődési szint szerinti "agy", vagy annak korábbi fejlődéstani elemei) mint "okosmotor termékei" és a bel (visszacsatolás az okosmotorhoz a belső működés optimalizálására), valamint a változó időben és térben történő fejlődés, túlélés biztosítására.

A valóságban a folyamatok nagyon sokfélék lehetnek, mert a "mozgató rugói" sokfélék.

A folyamatok rugóinak sokfélesége ha végtelennek látszik, véletlenről beszélünk, aminek, vagy amiknek az oka -amennyiben fontos az ok (jelentős tényező a sokféle kutatási ágban) kiderítése- kutatjuk, és az eredményeket felhasználva, a folyamatokat befolyásoljuk, vagy nem, ha nem találtuk meg... Ha rossz irányba viheti az addigi folyamatot a megtalált ok (előre látás mérlegelés útján, korábbi ismeretek felhasználásával) elvetjük a kezdeti "késztetést" ("észnélküliségnek", mivel nem kontrollált, de akár az is kiderülhet hogy jó volt a "spontán" gondolat) a további folyamatok fenntartásához vagyis az ész által nem ellenőrzött de számunkra tetszetős, megvalósított gondolatokat, és a visszacsatolt összes adatot feldolgozva és a környezettel összhangba hozás szándékával, megerősítjük vagy módosítjuk, vagy elvetjük azt. Még ekkor is van tévedési lehetőség, mert minden szemszögből többnyire szinte lehetetlen a vizsgálódás, ezért nevezik optimalizálásnak.

Szerintem, a "folyamatos, vagy szenvedő ige" típusú merev szabályrendszer a nyelvben" alkalmazására épülő optimalizálás (ami programban tükröződik) kevés és nem "biológiai modern", gondolkozni képes robotok megvalósítására. A lényegesnek vélt valós helyzetek térben és időben követése és az adatok feldolgozása, a korábbi ismeretekkel együtt, megközelítheti egy "szuper agy" típusú gépi intelligencia létrehozását.

Fórum cikk: Utolsó mondat vége: "....amikor elvont, akkor viszont kérdés, hogy mihez kötődik." (mármint a főnév)..

A főnév valamilyen típusú nyelvtani szerkezethez és a benne meglévő elemekhez mindenképpen kötődik. Ha mereven "statikus" a szerkezet, vagyis mereven szabályosak az elemek (korlátozott számban, és értelemben), "képtelen" arra, hogy érzelmeket fejezzen ki, előre látóan (vizsgálódva, mérlegelve), optimálisan helyes döntéseket hozzon, mint ahogy arra az élő világ akár elemi szinten, vagy bonyolult megnyilvánulásaiban is képes.

Az un. "folyamatos"', vagy "szenvedő" igéknek pl. már az elnevezése is mutatja, hogy "szerkezetre" (összességében annak elemeire) utalnak, nem pedig önállóan dönteni és tudatában fejlődni képes természetes, vagy amit szeretnének megvalósítani, "mesterséges" agyra.

Az agy eszköze a gondolkozás, ami tapasztalatokra épül.

A nyelv a kommunikáció különleges, rugalmas eszköze (valamilyen/ bármilyen élőlény valamilyen módon létrehozta) a spontán ész (a genetikai fejlődési szint szerinti "agy", vagy annak korábbi fejlődéstani elemei) mint "okosmotor termékei" és a bel (visszacsatolás az okosmotorhoz a belső működés optimalizálására), valamint a változó időben és térben történő fejlődés, túlélés biztosítására.

A valóságban a folyamatok nagyon sokfélék lehetnek, mert a "mozgató rugói" sokfélék.

A folyamatok rugóinak sokfélesége ha végtelennek látszik, véletlenről beszélünk, aminek, vagy amiknek az oka -amennyiben fontos az ok (jelentős tényező a sokféle kutatási ágban) kiderítése- kutatjuk, és az eredményeket felhasználva, a folyamatokat befolyásoljuk, vagy nem, ha nem találtuk meg... Ha rossz irányba viheti az addigi folyamatot a megtalált ok (előre látás mérlegelés útján, korábbi ismeretek felhasználásával) elvetjük a kezdeti "késztetést" ("észnélküliségnek", mivel nem kontrollált, de akár az is kiderülhet hogy jó volt a "spontán" gondolat) a további folyamatok fenntartásához vagyis az ész által nem ellenőrzött de számunkra tetszetős, megvalósított gondolatokat, és a visszacsatolt összes adatot feldolgozva és a környezettel összhangba hozás szándékával, megerősítjük vagy módosítjuk, vagy elvetjük azt. Még ekkor is van tévedési lehetőség, mert minden szemszögből többnyire szinte lehetetlen a vizsgálódás, ezért nevezik optimalizálásnak.

Szerintem, a "folyamatos, vagy szenvedő ige" típusú merev szabályrendszer a nyelvben" alkalmazására épülő optimalizálás (ami programban tükröződik) kevés és nem "biológiai modern", gondolkozni képes robotok megvalósítására. A lényegesnek vélt valós helyzetek térben és időben követése és az adatok feldolgozása, a korábbi ismeretekkel együtt, megközelítheti egy "szuper agy" típusú gépi intelligencia létrehozását.

Fórum cikk: Utolsó mondat vége: "....amikor elvont, akkor viszont kérdés, hogy mihez kötődik." (mármint a főnév)..

A főnév valamilyen típusú nyelvtani szerkezethez és a benne meglévő elemekhez mindenképpen kötődik. Ha mereven "statikus" a szerkezet, vagyis mereven szabályosak az elemek (korlátozott számban, és értelemben), "képtelen" arra, hogy érzelmeket fejezzen ki, előre látóan (vizsgálódva, mérlegelve), optimálisan helyes döntéseket hozzon, mint ahogy arra az élő világ akár elemi szinten, vagy bonyolult megnyilvánulásaiban is képes.

Az un. "folyamatos"', vagy "szenvedő" igéknek pl. már az elnevezése is mutatja, hogy "szerkezetre" (összességében annak elemeire) utalnak, nem pedig önállóan dönteni és tudatában fejlődni képes természetes, vagy amit szeretnének megvalósítani, "mesterséges" agyra.

Az agy eszköze a gondolkozás, ami tapasztalatokra épül.

A nyelv a kommunikáció különleges, rugalmas eszköze (valamilyen/ bármilyen élőlény valamilyen módon létrehozta) a spontán ész (a genetikai fejlődési szint szerinti "agy", vagy annak korábbi fejlődéstani elemei) mint "okosmotor termékei" és a bel (visszacsatolás az okosmotorhoz a belső működés optimalizálására), valamint a változó időben és térben történő fejlődés, túlélés biztosítására.

A valóságban a folyamatok nagyon sokfélék lehetnek, mert a "mozgató rugói" sokfélék.

A folyamatok rugóinak sokfélesége ha végtelennek látszik, véletlenről beszélünk, aminek, vagy amiknek az oka -amennyiben fontos az ok (jelentős tényező a sokféle kutatási ágban) kiderítése- kutatjuk, és az eredményeket felhasználva, a folyamatokat befolyásoljuk, vagy nem, ha nem találtuk meg... Ha rossz irányba viheti az addigi folyamatot a megtalált ok (előre látás mérlegelés útján, korábbi ismeretek felhasználásával) elvetjük a kezdeti "késztetést" ("észnélküliségnek", mivel nem kontrollált, de akár az is kiderülhet hogy jó volt a "spontán" gondolat) a további folyamatok fenntartásához vagyis az ész által nem ellenőrzött de számunkra tetszetős, megvalósított gondolatokat, és a visszacsatolt összes adatot feldolgozva és a környezettel összhangba hozás szándékával, megerősítjük vagy módosítjuk, vagy elvetjük azt. Még ekkor is van tévedési lehetőség, mert minden szemszögből többnyire szinte lehetetlen a vizsgálódás, ezért nevezik optimalizálásnak.

Szerintem, a "folyamatos, vagy szenvedő ige" típusú merev szabályrendszer a nyelvben" alkalmazására épülő optimalizálás (ami programban tükröződik) kevés és nem "biológiai modern", gondolkozni képes robotok megvalósítására. A lényegesnek vélt valós helyzetek térben és időben követése és az adatok feldolgozása, a korábbi ismeretekkel együtt, megközelítheti egy "szuper agy" típusú gépi intelligencia létrehozását.

Fórum cikk: Utolsó mondat vége: "....amikor elvont, akkor viszont kérdés, hogy mihez kötődik." (mármint a főnév)..

A főnév valamilyen típusú nyelvtani szerkezethez és a benne meglévő elemekhez mindenképpen kötődik. Ha mereven "statikus" a szerkezet, vagyis mereven szabályosak az elemek (korlátozott számban, és értelemben), "képtelen" arra, hogy érzelmeket fejezzen ki, előre látóan (vizsgálódva, mérlegelve), optimálisan helyes döntéseket hozzon, mint ahogy arra az élő világ akár elemi szinten, vagy bonyolult megnyilvánulásaiban is képes.

Az un. "folyamatos"', vagy "szenvedő" igéknek pl. már az elnevezése is mutatja, hogy "szerkezetre" (összességében annak elemeire) utalnak, nem pedig önállóan dönteni és tudatában fejlődni képes természetes, vagy amit szeretnének megvalósítani, "mesterséges" agyra.

Az agy eszköze a gondolkozás, ami tapasztalatokra épül.

A nyelv a kommunikáció különleges, rugalmas eszköze (valamilyen/ bármilyen élőlény valamilyen módon létrehozta) a spontán ész (a genetikai fejlődési szint szerinti "agy", vagy annak korábbi fejlődéstani elemei) mint "okosmotor termékei" és a bel (visszacsatolás az okosmotorhoz a belső működés optimalizálására), valamint a változó időben és térben történő fejlődés, túlélés biztosítására.

A valóságban a folyamatok nagyon sokfélék lehetnek, mert a "mozgató rugói" sokfélék.

A folyamatok rugóinak sokfélesége ha végtelennek látszik, véletlenről beszélünk, aminek, vagy amiknek az oka -amennyiben fontos az ok (jelentős tényező a sokféle kutatási ágban) kiderítése- kutatjuk, és az eredményeket felhasználva, a folyamatokat befolyásoljuk, vagy nem, ha nem találtuk meg... Ha rossz irányba viheti az addigi folyamatot a megtalált ok (előre látás mérlegelés útján, korábbi ismeretek felhasználásával) elvetjük a kezdeti "késztetést" ("észnélküliségnek", mivel nem kontrollált, de akár az is kiderülhet hogy jó volt a "spontán" gondolat) a további folyamatok fenntartásához vagyis az ész által nem ellenőrzött de számunkra tetszetős, megvalósított gondolatokat, és a visszacsatolt összes adatot feldolgozva és a környezettel összhangba hozás szándékával, megerősítjük vagy módosítjuk, vagy elvetjük azt. Még ekkor is van tévedési lehetőség, mert minden szemszögből többnyire szinte lehetetlen a vizsgálódás, ezért nevezik optimalizálásnak.

Szerintem, a "folyamatos, vagy szenvedő ige" típusú merev szabályrendszer a nyelvben" alkalmazására épülő optimalizálás (ami programban tükröződik) kevés és nem "biológiai modern", gondolkozni képes robotok megvalósítására. A lényegesnek vélt valós helyzetek térben és időben követése és az adatok feldolgozása, a korábbi ismeretekkel együtt, megközelítheti egy "szuper agy" típusú gépi intelligencia létrehozását.

Fórum cikk: Utolsó mondat vége: "....amikor elvont, akkor viszont kérdés, hogy mihez kötődik." (mármint a főnév)..

A főnév valamilyen típusú nyelvtani szerkezethez és a benne meglévő elemekhez mindenképpen kötődik. Ha mereven "statikus" a szerkezet, vagyis mereven szabályosak az elemek (korlátozott számban, és értelemben), "képtelen" arra, hogy érzelmeket fejezzen ki, előre látóan (vizsgálódva, mérlegelve), optimálisan helyes döntéseket hozzon, mint ahogy arra az élő világ akár elemi szinten, vagy bonyolult megnyilvánulásaiban is képes.

Az un. "folyamatos"', vagy "szenvedő" igéknek pl. már az elnevezése is mutatja, hogy "szerkezetre" (összességében annak elemeire) utalnak, nem pedig önállóan dönteni és tudatában fejlődni képes természetes, vagy amit szeretnének megvalósítani, "mesterséges" agyra.

Az agy eszköze a gondolkozás, ami tapasztalatokra épül.

A nyelv a kommunikáció különleges, rugalmas eszköze (valamilyen/ bármilyen élőlény valamilyen módon létrehozta) a spontán ész (a genetikai fejlődési szint szerinti "agy", vagy annak korábbi fejlődéstani elemei) mint "okosmotor termékei" és a bel (visszacsatolás az okosmotorhoz a belső működés optimalizálására), valamint a változó időben és térben történő fejlődés, túlélés biztosítására.

A valóságban a folyamatok nagyon sokfélék lehetnek, mert a "mozgató rugói" sokfélék.

A folyamatok rugóinak sokfélesége ha végtelennek látszik, véletlenről beszélünk, aminek, vagy amiknek az oka -amennyiben fontos az ok (jelentős tényező a sokféle kutatási ágban) kiderítése- kutatjuk, és az eredményeket felhasználva, a folyamatokat befolyásoljuk, vagy nem, ha nem találtuk meg... Ha rossz irányba viheti az addigi folyamatot a megtalált ok (előre látás mérlegelés útján, korábbi ismeretek felhasználásával) elvetjük a kezdeti "késztetést" ("észnélküliségnek", mivel nem kontrollált, de akár az is kiderülhet hogy jó volt a "spontán" gondolat) a további folyamatok fenntartásához vagyis az ész által nem ellenőrzött de számunkra tetszetős, megvalósított gondolatokat, és a visszacsatolt összes adatot feldolgozva és a környezettel összhangba hozás szándékával, megerősítjük vagy módosítjuk, vagy elvetjük azt. Még ekkor is van tévedési lehetőség, mert minden szemszögből többnyire szinte lehetetlen a vizsgálódás, ezért nevezik optimalizálásnak.

Szerintem, a "folyamatos, vagy szenvedő ige" típusú merev szabályrendszer a nyelvben" alkalmazására épülő optimalizálás (ami programban tükröződik) kevés és nem "biológiai modern", gondolkozni képes robotok megvalósítására. A lényegesnek vélt valós helyzetek térben és időben követése és az adatok feldolgozása, a korábbi ismeretekkel együtt, megközelítheti egy "szuper agy" típusú gépi intelligencia létrehozását.

" A magyar "húgom-néném/nővérem" nem azonos a "my sister" kifejezéssel, mert a "szerelés" folyamatában (a transzformációban) nálunk kötelezően ott van a +[relatív kor]. De már létezik a Facebookos gépi fordítás, hogy "lánytestvér"... A rendszer nagy része az NLP szerint tudattalan, e szempontból csak annyi tudatos, amennyit egyszerre kódban fogalmazunk...Nem tudom, ez a rendszerelvű felfogás mennyire jellemző a mai szemantikának az írott internetes nyelv fordításában való alkalmazására, de az eredményekből inkább azt "veszem le", hogy eleve inkább azt tudják jobban fordítani - a tudatosabb, írott nyelvből - ami hasonlít az övékhez..."Az amit írtál, és ami sajnos így van úgy gondolom ma is, olyan "egysíkú" fordítói rendszerre utal, ami a "távoli, vagy magas/ közeli vagy mély" nyelvi megjelenítések közötti összeköttetéseket nem hozta létre, nem látja, ami követhetné a "több (többnyire tört) dimenziós" világ nyelvi megjelenéseinek világát...A fraktál matematikai szemlélet áll közel szerintem ahhoz a jövőbeni rendszerhez, ami ha létre jönne, akkor képes volna "mozogni" az új fordítási rendszer a különböző nyelvi dimenziók (meglátások a helyi világban, helyi társadalmakban élők emberi kapcsolatai, helyi vagy biológiai adottságokból adódó különböző érzelmi megnyilvánulások és így tovább, nyelvi megjelenítései nyelvtani rendszerekben, és konkrét kifejezésekben). Nem kéne az angolhoz "sztendernizálni" a merőben különböző lefordítandó nyelveket, mert a sokdimenziós világ meglátásának sokszínűsége szenved csorbát és válik "egydimenziós tört nyelvé".. Vállalni kéne azt, hogy a "nyelvi (tört) dimenziók" közé szükségesek bizonyos magyarázatok, amiknek a hozadéka az volna, hogy sokkal közelebb kerülnének egymáshoz a másképpen gondolkozó és beszélő népek.A földi világ teljességét végül is úgy gondolom, nem kéne sematikusan, egy tört dimenziós nyelv "dobozába" kényszeríteni, mert a "világlátás" sokdimenziós nyelvek összességével lehet (majdnem) teljes.

Nem tudom, hogy a távolkeleti nyelveket (hasonló szemléletű írásmóddal bíró nyelvek) "egymás között" ugyanolyan elvek alapján fordítják-e le mintha pl. angolra vagy angolról fordítanának.. Jó volna erről valahol népszerű formában olvasni..

Tapasztalom, hogy "nyers fordításnak" jól megfelel az adott szöveg tartalmának feldolgozását biztosító, eddigi fordítói rendszer pl. angol-magyar fordítás vonatkozásában ...

A magyar szemlélet ami a nyelvünk alapján leszűrhető, talán velünk kapcsolatban úgy működne, hogy az "egészből" (= "fő doboz"), vagyis néhány jelentős információ alapján (a nyers fordítás alapján) meghatározott egység felvázolásával (pl. milyen nyelven, mikor, miről készült az adott szöveg (pl. hivatalos, nem hivatalps, szakszöveg, nem szakszöveg/ képekkel megjeleníthető témában, stb.. ( a témák további "aldobozokat" is tartalmaznának)) megkapnánk egyfajta "kiinduló pontot"....

A "kereső" a meglévő információk alapján (szavak, nyelvtani fordulatok) a valószínű "dobozokhoz vezető linkeket" beazonosítaná (amik rész információk felé mutatnak, pl. szavak, specifikus nyelvi fordulatok egyedi nyelvi sajátosságok alapján, stb.) előre kijelölné a "térben elhelyezett dobozokhoz" vezető utat, amelyek tartalmaznák a korábbi, ellenörzött fordításokból nyert, korrekt mondathalmazokhoz vezető "al linkeket" (meggyorsítva a pontosító, "helyes" fordítást), amelyek közül a legvalószínűbbet "beemelné" a (nyers) fordításba..

Persze lehet, hogy jelenleg is valami hasonló működik, nem gondolom, hogy ez "spanyolviasz", amit fel kéne találni, de valahogy még nem igazán jól működik.. Talán nincs még elegendő "aldoboz" ami a magyar fordításokat a jelenleinél korrektebbé tenné..:)

Érdekes írás, és a gépi fordítás kérdésében alátámasztja a tapasztalat (jómagam fordító is vagyok). Amit még sejtek, hogy az NLP (amelyet vagy 19 éve tanulmányozok és művelek, elsősorban terápiás és kommunikáció-javító szerepében) alkalmazza a korai Chomsky-elemzések módszerét (Syntactic Structures) pl. az ericksoni hipnotikus nyelv és viselkedés elemzésére, de a generatív szemantika már más irányba fejlődött, ami nem egyezik már az NLP-vel annyira, mint Chomsky korában, miközben az NLP a nyelvtanulás és a más kultúrákba való "belépés" témájában érdekes eredményeket hozott. A nem verbális azonosulásnak pl. a nyelvzseni John Grinder megfigyelései szerint a kezdeti szakaszban sokkal nagyobb szerepe van, mint a kód tudatos memorizálásának. Ezt az AI nemigen fogja tudni reprodukálni, mert nincs benne különbség a tudatos és a tudattalan között (NLP-s szóval élve).

Ilyen szempontból, kicsit egyszerűsítve, a mélystruktúrát az NLP alapítói (Bandler és Grinder - pl. a Patterns of the Hypnotic Techniques of Milton H. Erickson, M.D. c. munkájukban) érzékszervi konkrétumokhoz kötötték, ugyanakkor fenntartva azt a tudományfilozófiai paradoxont (amely inkább Gregory Batesonhoz köthető), hogy a különféle nyelvek és a különféle egyének (plusz a különféle tudatállapotok) eleve másképpen osztják fel a világot. Az NLP módszertana inkább a szubjektív megismerés és modellezés eszköztára, igazából mintegy agnosztikus és gyakorlatias, némileg változó rendszer, nem világleírás. Ilyen értelemben tehát még az a buddhista ízű kijelentés lenne leginkább igaz a gyakorlati NLP tapasztalataira (a nyelvtanulásban is), hogy "a jelentés üres", ti. önmagában üres, nem külső "tárgyakra" utal (ahogyan az egyszerű nyelvtanuló feltételezi), mivel már a tárgyak felosztása is kódfüggő. Egy pók teljesen másképpen oszthatja föl a világot, mint egy magyar anyanyelvű ember... Ezzel összhangban van Lakoff értelmezése a nyelvi metaforákról, és itt már filozófiai vizekre evezünk...

Ennek az "ürességnek" vagy európai szóval agnoszticizmusnak az alapja valami olyan ki nem mondott, de gyakorolt meta-meggyőződés vagy elv, hogy minden kódelem csak rendszerben értelemezhető, ahogyan a fonémák a fonológiában. A magyar "húgom-néném/nővérem" nem azonos a "my sister" kifejezéssel, mert a "szerelés" folyamatában (a transzformációban) nálunk kötelezően ott van a +[relatív kor]. De már létezik a Facebookos gépi fordítás, hogy "lánytestvér"... A rendszer nagy része az NLP szerint tudattalan, e szempontból csak annyi tudatos, amennyit egyszerre kódban fogalmazunk...

Nem tudom, ez a rendszerelvű felfogás mennyire jellemző a mai szemantikának az írott internetes nyelv fordításában való alkalmazására, de az eredményekből inkább azt "veszem le", hogy eleve inkább azt tudják jobban fordítani - a tudatosabb, írott nyelvből - ami hasonlít az övékhez. Ez viszont inkább a (nem ELF-angol) nyelveket módosítja majd inkább, ahogyan a Facebookos "lánytestvér" és a "szép napot" és hasonló kifejezések is...

Egy verbális megnyilatkozást, legyen az bármilyen nyelven megfogalmazva, úgy kell elképzelnünk, mint egy kisebb térbeli szerkezetet – szemben azzal, amelyet az írásban lefektetett megnyilatkozások síkbeli, mondattani elemzése hálószerű szerkezetnek mutat.

Ez utóbbi esetben a mondatokat gráf vagy fa struktúrában szokás felvázolni, amely összecsukható egy lineáris sorozattá, amelyben az egyes elemeket szófaji címkével szokás ellátni. Ez a PoS tagging része a gépi fordítási algoritmusoknak, amelyekről azt tartják, hogy szemantikai elemzésen alapszik, amelynek összetevői egy részt a statisztikai adatok, más részt a nyelv bizonyos szabályai. E két ismérv alapján „statistical and rule based” gépi fordító programok terjedtek el, de egyik sem képes „hibátlan” célnyelvi fordításra.

Ennek ellenére az NLP területen aktív kutatók azt tartják, hogy az egyre nagyobb adatbázis és a finomabb szabálykészlet pontosabb fordításokhoz fog vezetni. Ennek értelmében olyan részletkérdésekkel[1] foglalkoznak, mint az anaforák feloldása, a metaforák, az idiómák és hasonlók, de újabban az AI kutatások nyomán szerephez jutott felsőszintű ontológiákat is bevonják. Ennek egyik eredménye, hogy a WordNet angol egynyelvű szótára egyesítették azzal az ontológiával, amelynek a célja szintén a nyelv szókincsének leltározása, de immár nem betűrendi, hanem fogalmi struktúrával[2] egybeépítve és rendezve.

Ennek az ontológiai adatbázisnak a neve SUMO, és láthatóan igen elégedettek a készítői a jelenlegi formájával, amelynek azonban lényeges hiányosságai vannak. Magyar nyelven is készült egy egységes ontológia, a MEO, amely azonban szintén hiányos elméleti, osztályozási szempontból, de nem tudunk arról, hogy ez az ontológia és a Magyar Nyelv Értelmező szótárának egyesítése tervbe van-e véve a WordNet-hez hasonlóan, aminek viszont tudomásunk szerint Szegeden már évek óta készül egy magyar nyelvű változata.

Az álom, hogy a domén ontológiák egyesíthetőek legyenek, ami rokon az egyfajta egységes tudomány vagy világelmélet koncepcióval nyilván azért nem valósul meg, mert a domének szakemberei nem rendelkeznek egy olyan közös modellel és interfésszel, amely efféle integrációt megengedne. Azt kellene ugyanis belátni, hogy a kommunikáció során az ember, szerelő tevékenységet végez, a nyelv elemeivel épít fel egy világ reprezentációt és igyekszik azt egyrészt tartósítani, másrészt megosztani és terjeszteni.

Ahhoz, hogy ilyen szerelt produktum létrejöjjön, nem elég az „alkatrészeket” számba venni, leltározni, hanem magát a szerelést is tudni kell dokumentálni. Sőt, az egész „gyártás” előfeltétele, hogy tudjuk, milyen terméket akarunk előállítani, persze azzal a megszorítással, hogy azt is tudjuk, miből tudunk dolgozni. Ebből a szempontból pedig az a legfontosabb tudás, hogy tudjuk, mit mivel lehet házasítani vagy párosítani, merthogy ilyen tulajdonság nélkül nem fog összeállni egy összetett alkotás.

Mivel a jelenlegi NLP kutatást és az AI-t is matematikai megközelítés uralja annak az általános meggyőződésnek köszönhetően, hogy a tudomány csak akkor tudomány, ha metrikus, illetve ha a leírás vagy ábrázolás egybeesik valamilyen matematikai modellel, a szerelési tervek, ha annak nevezhetők egyáltalán, úgy készülnek, hogy a sok legyártott termékeket statisztikailag elemzik, és azok eredményeit használják fel „hasonmás” termékek előállítására. Ám ez az eljárás, amellett, hogy kétségtelenül agymunkát takarít meg, agyatlan prototípusokat és gyártmányokat is felhasznál, amit nem lenne szabad megengedni. Főleg azért nem, mert ebben a felfogásban minden hibás produktumot egyenként kell kijavítani, így a kisszámú általános szabályok helyett nagyszámú egyedi megoldást kell felismerni és alkalmazni.

A természet nem így működik, és a törvények sem ilyen megoszlásúak. A kisszámú szabályokat nagyszámú esetre alkalmazzuk, azok a modell változói, amelyek a behelyettesítés, a rekurzió alkalmazása révén nagyszámú értéket vehetnek fel és ezzel van biztosítva a variabilitás, a termék diverzifikáció.

A természetes nyelvek esetében se lehet ez nagyon másképpen, ezt bizonyítják maguknak a nyelveknek, mint produktumoknak az összetevői, illetve az, hogy a kombinációk nagy száma ellenére sem haladja meg az elemek száma a megtanulható nagyon is alacsonyan véges számot. A kombinációk nem matematikai, agyatlan kombinációk, hanem korlátozottan használatra alkalmas esetek, amelyek utólagos kiválogatásával szemben létezik a cél szerint alkalmas esetek kiválogatási módszere is, vagyis pontosan az, ami a valóságban is történik.

Csakhogy a valóságban a nyelvtudomány magának a nyelvi formáknak a leírásával foglalkozik, a teljes kommunikációs folyamatot nem veszi figyelembe, mivel az már nem tárgya a nyelvtudománynak. Ezt a felfogást némileg megújítja D. Crystal, akinek DEED modellje már nem elszigetelten látja a nyelvi közléseket, csupán egyetlen, formai, nyelvtani elemzési szempontból, hanem erősen elmozdul a szemantikai elemzés irányában.

Ám a szemantikai elemezést az a drámai vég érte, hogy azt az AI szakemberei logikai elemzésként fogják fel, és gyakorlatilag nem érdekli őket más, mint a kijelentések igazságtartalma, vagyis egyetlen változó két értéke, amit könnyen lehet számítógéppel reprezentálni vagy ábrázolni illetve számszerűsíteni.

Kétségtelen, hogy ennek a felfogásnak megvan a haszna és a tanulsága, de a természetes nyelvek feldolgozásában, sem a formális logika, sem a halmazelmélet nem látszik megfelelő szerszámnak ahhoz, hogy sikerüljön pontosabban dolgozó fordítóprogramokat tervezni és írni. Ezt maguk a terület szakemberei is kezdik belátni. Ha nem kapnának pénzt arra, hogy a tengernyi nyelvi anyagban olyan szavakra vagy szövegekre halásszanak, amelyek a feltételezések szerint nemzetbiztonságilag érdekesek, vagy kockázatosak, akkor már valószínűleg megpróbálkoztak volna egy vagy több multidiszciplináris megközelítéssel is, ahogy az agykutatás fejlődésével ezek az irányzatok is megjelentek.

Ám ezek a kapcsolt vizsgálatok a mai nyelvészeti paradigmából indulnak ki, vagyis többnyire szavakból, esetleg szófajokból, és azokat, mint elemeket hozzák kapcsolatba a viselkedéssel, illetve egyéb idegrendszeri, agyi és motorikus folyamatokkal. Erre a témára is lehet pénzt szerezni, mert a kutatás célja az agy működésének kívülről történő lekérdezése vagy befolyásolása, ahogy ezt majomkísérlet mutatják. Nyilván a mindenkori kormányok szívesen adnak pénzt arra, amit biztonságfokozó projektnek vélnek, legyen az fegyver vagy gyógyszer, vagy direkt propaganda, stb.

De az államok egy bizonyos mértékig az oktatási kutatásokat is finanszírozzák, sőt állandóan meg is változtatják az oktatási rendszereket, mert azokat éri a legtöbb kritika, mivel nem váltják be azokat a reményeket, amelyeket hozzájuk fűznek. Például nem elég jó a tehetségek szelekciója és érvényesülése, és nem segíti eléggé a szociális felemelkedést vagy a meggazdagodást – szemben más társadalmi technikákkal.

Ettől függetlenül csak az oktatástól remélhető, hogy a kölcsönös megértés a nyelvi és tudásbeli, valamint szociális és kulturális különbségek ellenére kialakuljon, ha nem is az egynyelvűség vagy az egy ideológiaiság jegyében, hanem az „átjárhatóság”, a ”megfeleltetés” és a „behelyettesítés” jegyében, amely intellektuális műveletek érzelmi megfelelője az empátia, a szolidaritás érzése, vagyis az együttérzés, az érzelmek szinkronizálása.

Az érzelmek szinkronizálása azonban megoldott feladatnak látszik, lévén hogy a zene, a tánc és a tömeges közös együttlét például nézőként erre alkalmat ad. De nem megoldott a racionális, értelmi tudattartalmak ilyen fokú megosztása és harmonizációja, mivel az iskolai oktatásban is nehéz tudás színvonalat tekintve homogén csoportokat létrehozni, nemhogy az osztályoknál nagyobb létszámban. Az értő olvasás és szókincsvizsgálat csupán egy halvány kísérlet arra, hogy legalább a mérés idejére összehasonlíthatóvá tegyük az egyébként szerteágazó ismeretekkel rendelkező gyerekek lexikális tudását.

De valójában a lexikális tudás egy szintre hozása, vagy ezen a terület indított trivia típusú versengések nem szolgálják az „illeszkedés” célját, mert a nyelvi megnyilatkozások mögötti tudati valóságnak csak egy részét hordozzák a szavak, egy jelentős része a tudásnak, amely már nehezen választható el a nyelvi kompetenciától, a hogyanra és a mikéntre vonatkozik, azaz a szabályokra vagy utasításokra, amelyeket a nyelvi teljesítés során követni kell.

Következésképpen a nyelv elsajátítása során nemcsak a nyelvtani, majd a pragmatikai és szemantikai szabályokat kell elsajátítani, hanem az alkalmazási szabályokat is, amibe beletartozik a hol és a mikor és a miért kérdése is valamilyen, a nyelvi közlést meghaladó, vagy azt csak eszközül használó közeg vagy környezet is, vagyis lehetőleg valamilyen munka- vagy szakterület. Erre már rájöttek néhányszor a középiskolás képzés visszatérő reformerei, de anélkül, hogy a meglévő doktrínákat, a tantárgyi csoportosításokhoz és tartalmukhoz hozzányúltak volna.

Lásuk be, ez ugyanaz a probléma, mint az idegen-nyelv tudás és a szaktudás kérdése, azaz a tananyag oldaláról nézve a domén és a felsőszintű ontológiák egyesítésének kérdése. Ám addig, amíg a felsőszintű ontológia csupán lexikális ismeretekre terjed ki, nyilvánvaló, hogy nem lehet benne közös know-how, vagy a hogyan és miként ismeretanyaga, mert a lexikális anyag főnevekből áll, amelyek egy része konkrét, másik része elvont, vagyis, ha konkrét, akkor kötődik valamilyen szakterülethez, annak tárgyaihoz, egy doménhez, vagy universe of discourse-hoz, és amikor elvont, akkor viszont kérdés, hogy mihez kötődik.

[1] ahhoz képest részletkérdés, hogy a jel és a jelölt dolog megfelel-e egymásnak, illetve azok léteznek-e

[2] ez a struktúra rendre hierarchikus, azaz azt az elképzelést tükrözi, hogy minden egyből vezethető le a világban, pl. a Big Bang is. Más szóval azt tételezzük fel, hogy a nyelvi aktus produkció, és nem reprodukció, ami óriási tévedés, főleg azért, mert az emberek többsége olyasmit akar létrehozni, amit más még nem hozott létre, tehát eredeti művet (produkciót).A kérdés azonban az lesz, hogy minek a reprodukciója a nyelv?

Ezzel szemben a biológiában az a tapasztalat, hogy az élőlény egyedek kifejlődése (a reprodukció) vagy egy, vagy két elemmel kezdődik. De utána a filo- és az ontogenezis fejlődésmenete hasonlít.